IA Générative : Pourquoi vos données ne sont pas prêtes

Et comment réparer le moteur

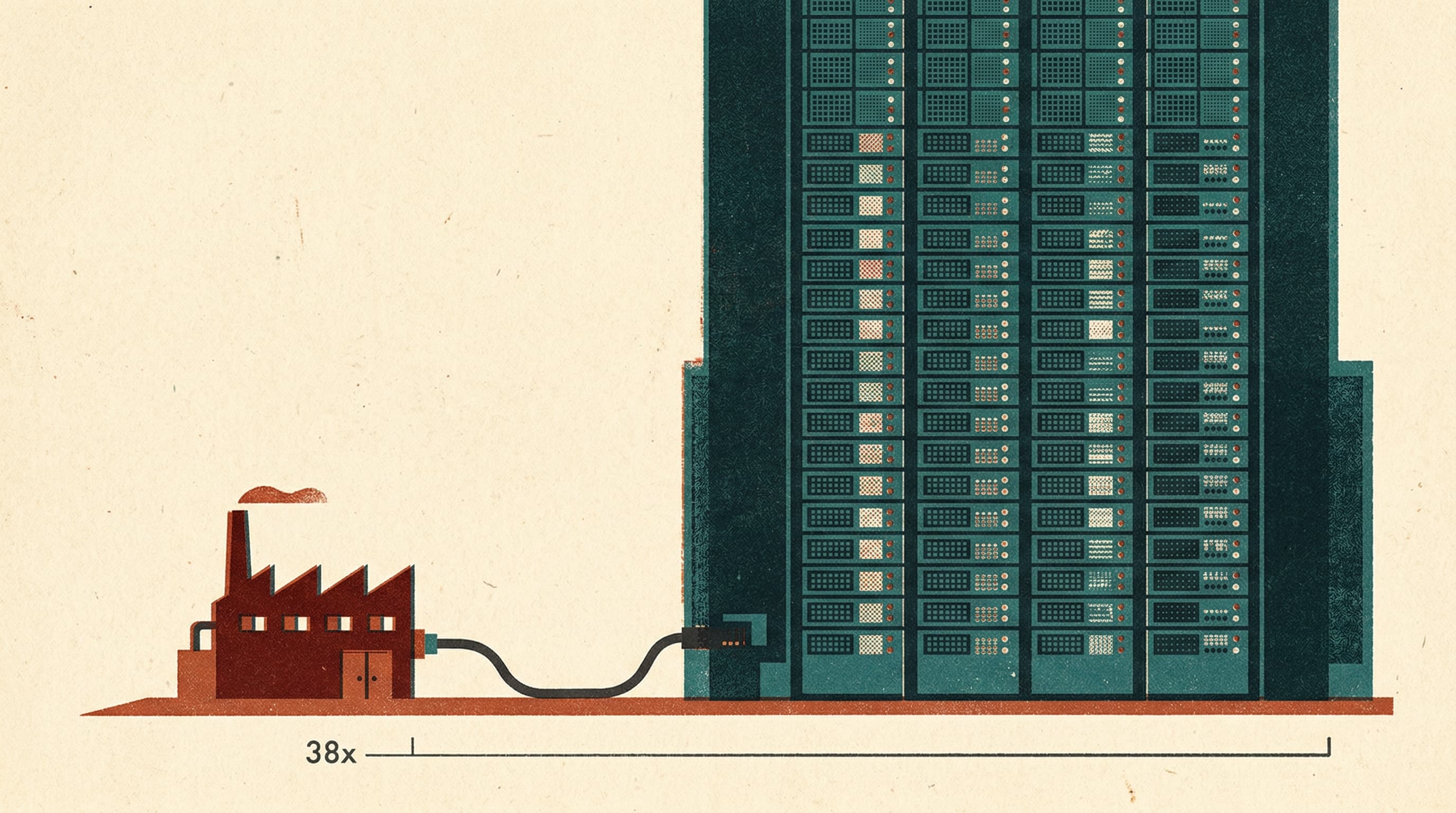

Nous vivons actuellement la rupture technologique la plus significative depuis l'internet commercial. Pourtant, passée l'euphorie des premières démos de GPT-4 ou Claude, une réalité opérationnelle froide rattrape les décideurs : la performance de ces modèles est intrinsèquement bridée par l'architecture des données sur laquelle ils reposent.

Si vous avez l'impression que votre IA "patine", qu'elle hallucine ou qu'elle manque de contexte, ce n'est probablement pas la faute du modèle. C'est la faute à quarante années de modélisation orientée vers les applications (comptabilité, ERP) qui se révèlent incompatibles avec les exigences cognitives de l'IA.

J'ai décortiqué un rapport de recherche exhaustif sur le sujet pour vous livrer une analyse chirurgicale des obstacles qui séparent vos données de l'IA, et les solutions pour les surmonter.

Le conflit : Transaction vs Déduction

Historiquement, nous avons conçu nos bases de données pour répondre à des questions binaires et connues à l'avance (ex: "Le produit X est-il en stock ?"). L'IA générative inverse cette logique : elle doit synthétiser une réponse complexe à partir de fragments dispersés.

C'est ici que se crée une "friction tectonique". Voici les quatre obstacles majeurs qui transforment cette friction en mur.

1. La logique est prisonnière du code

C'est l'obstacle le plus insidieux. Dans une architecture classique, la base de données est "bête" ; l'intelligence est dans le code (Java, C++, etc.). Le Modèle d'Objets Métiers (MOM) agit comme une structure exécutive rigide qui capture l'intelligence métier dans la couche applicative, dissociant ainsi totalement le sens de la donnée brute stockée.

L'exemple : Une colonne "Statut" contient la valeur 'S'. Pour la base de données, c'est une lettre. Pour l'application, via une ligne de code, cela signifie "Suspendu mais récupérable".

Le problème : L'IA connectée aux données ne voit que le 'S'. Elle n'a pas accès au code qui détient la clé de compréhension. Sans ce "principe d'organisation explicite", l'IA ne peut pas raisonner, elle ne peut que faire des corrélations statistiques.

2. L'échec du modèle relationnel

Paradoxalement, les bases de données relationnelles gèrent très mal les... relations profondes.

Pour détecter une fraude ou comprendre un contexte complexe, l'IA doit faire des sauts de connexion (A est lié à B, qui est lié à C...).

Au-delà de trois niveaux de profondeur (three-hop radius), les performances SQL s'effondrent.

Conséquence : Pour ne pas écrouler le système, on nourrit l'IA avec des données "plates", amputées de leur contexte relationnel, la rendant myope aux signaux faibles.

3. L'archipel des silos

L'intelligence, c'est la capacité de lier des concepts disparates. Or, nos entreprises sont des archipels de données isolés (Salesforce, SAP, WMS) sans identifiants communs.

- L'ambiguïté sémantique : Sans contexte unifié, l'IA ne peut pas résoudre le sens des mots. Un terme technique dans un document de maintenance peut avoir un sens totalement différent à la finance. Sans savoir "qui parle", l'IA hallucine.

4. Le fossé structuré / non-structuré

C'est le défi critique de l'ère des LLM. D'un côté, les bases de données (chiffres), de l'autre, les documents (PDF, mails).

Un rapport de maintenance contient souvent la causalité (ex: "Filtre encrassé -> Surchauffe pompe").

Mais pour les bases traditionnelles, ce document est un "BLOB", une boîte noire illisible. L'IA peine à lier une ligne de l'ERP à la procédure PDF correspondante.

La preuve par l'exemple : Le cas de l'Aéronautique

Pour comprendre l'impact concret, prenons l'exemple d'un géant de l'aéronautique qui a voulu créer un "Copilote de Maintenance".

L'IA devait répondre à une question simple d'un mécanicien : "Comment réparer la fuite sur la pompe hydraulique ?". Le projet a failli échouer. Pourquoi ?

La configuration de l'avion (quel numéro de série de pièce est installé ?) était dans l'ERP.

La procédure de réparation était dans un PDF.

L'IA, incapable de faire le pont rigoureux entre l'ID de la pièce (Structuré) et la mention textuelle dans le manuel (Non-structuré), hallucinait des procédures incompatibles.

La solution : Vers une navigation conceptuelle

Alors, comment sortir de l'impasse ? La réponse ne réside pas dans un meilleur modèle de langage, mais dans une meilleure mémoire numérique.

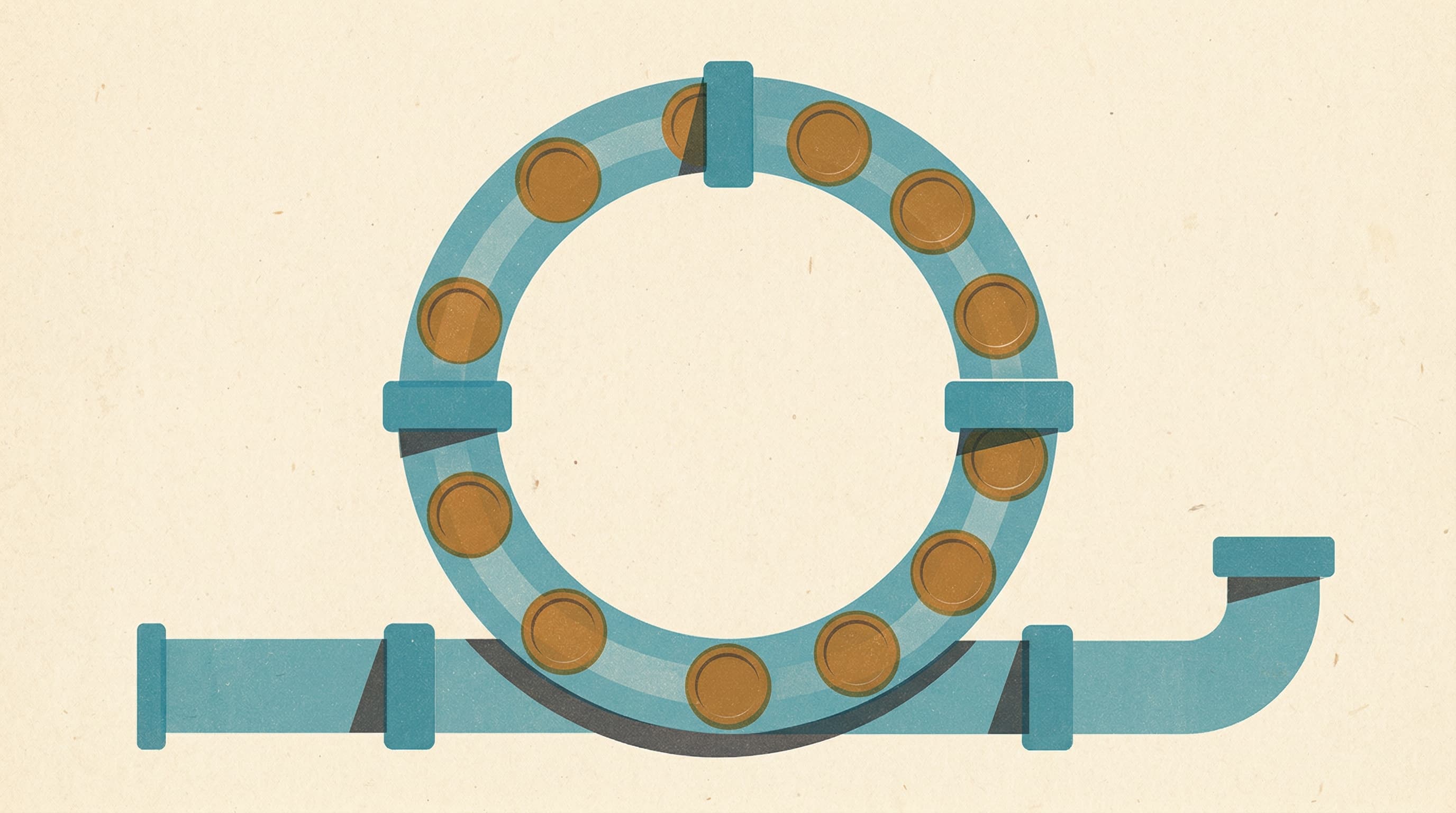

Le Graphe de Connaissances (Knowledge Graph)

C'est la pierre angulaire de la solution. Contrairement aux bases SQL, le graphe stocke la relation comme une donnée de première classe.

Logique explicite : La règle métier n'est plus cachée dans le code, elle est lisible dans le graphe.

Performance : Traverser 5 niveaux de relations se fait en millisecondes.

Pont sémantique : Le graphe est le seul modèle capable de relier proprement un nœud "Document PDF" à un nœud "Pièce ERP".

GraphRAG : L'avenir de l'IA en entreprise

La tendance actuelle est au GraphRAG (Graph Retrieval-Augmented Generation). Cette technique combine :

La recherche vectorielle (pour l'intuition et le flou linguistique).

La structure du graphe (pour la précision factuelle et le respect des liens causaux).

Cela permet à l'IA de "raisonner" en suivant un chemin précis : Machine X -> Ligne Y -> Produit Z -> Impact Financier, chose impossible avec une simple recherche par mots-clés.

Conclusion : Ne mettez pas une Formule 1 sur un chemin de terre

L'IA Générative agit comme un révélateur impitoyable du désordre de nos données. Tenter de déployer des LLM sophistiqués sur une architecture obsolète revient à construire une Formule 1 pour la faire rouler sur un chemin de terre : c'est possible, mais dangereux et économiquement non viable.

Votre prochain mouvement ? Cessez de concevoir vos modèles de données uniquement pour vos applications. Commencez à les concevoir pour vos agents cognitifs. Cela passe par l'investissement dans des couches sémantiques (Knowledge Graphs) et la libération des règles métier enfouies dans votre code historique.

C'est à ce prix que l'IA passera du statut de gadget coûteux à celui d'oracle industriel.