23 Millions d'Euros par Emploi — Le Vrai Prix de la Réindustrialisation par l'IA

En janvier 2026, la directrice financière d'OpenAI a confirmé un chiffre que personne n'a relevé. Le triplement des revenus de l'entreprise — de 6,7 à 20 milliards de dollars — suit exactement le triplement de ses ressources informatiques. Pas approximativement. Exactement. Sa formulation est clinique : "Notre capacité à servir nos clients suit directement celle des ressources informatiques disponibles."

Traduisons : OpenAI ne croît pas parce qu'elle trouve de nouveaux clients. Elle croît parce qu'elle branche de nouveaux serveurs. Son chiffre d'affaires n'est pas une métrique commerciale — c'est une fonction dérivée de sa consommation électrique. À 1,9 gigawatt, soit la puissance de deux réacteurs nucléaires, les revenus suivent les watts.

Ce fait change tout. Si le revenu de l'IA est indexé sur l'énergie, alors la question qui structure le marché n'est pas "qui a le meilleur modèle ?" mais "qui a le plus de mégawatts ?" Et cette question a des implications que la plupart des décideurs n'ont pas encore intégrées.

1. La cascade des pénuries

Le discours dominant traite chaque contrainte physique comme un problème isolé. Les puces manquent — on construit des fonderies. L'énergie manque — on signe des contrats. La mémoire manque — on investit. En réalité, ce que je vois dans les données de mars 2026, c'est une cascade séquentielle : chaque couche de la stack matérielle révèle sa pénurie au moment où la couche précédente est partiellement résolue.

Énergie. C'est la contrainte fondatrice, documentée depuis 2025. Les data centers consomment déjà 22 % du réseau électrique irlandais — un pays de 5,1 millions d'habitants. Les délais de raccordement au réseau haute tension : 5 à 7 ans. Chaque gigawatt contracté par un data center est physiquement indisponible pour une usine, un hôpital, un immeuble.

Puces. Nvidia concentre 1 000 milliards de dollars de capitalisation sur un parc de 20 millions de GPU. La monoculture est telle que Meta, OpenAI et Amazon conçoivent désormais leurs propres puces pour s'en affranchir — mais ces alternatives ne seront matures qu'en 2027-2028.

Mémoire. Le chairman de SK Group prédit des pénuries de mémoire HBM jusqu'en 2030. Ces puces-mémoire, soudées directement sur les GPU, sont le goulet le plus discret et le plus contraignant : sans HBM, le GPU le plus puissant reste un processeur sans données.

Stockage. En marge de la GTC 2026, Greg Matson, vice-président de Solidigm (filiale SK Hynix), déclare que les systèmes IA de fin 2026 nécessiteront 35 % de stockage SSD en plus. "Je pourrais vendre deux fois plus que ce que je vends aujourd'hui." Jensen Huang confirme : "Le système de stockage va être pilonné." Pénurie prévue : jusqu'en 2030.

Refroidissement. En mars 2026, Ecolab — une entreprise de traitement des eaux — a racheté CoolIT Systems pour 4,75 milliards de dollars, soit 8,6 fois le chiffre d'affaires. CoolIT conçoit des systèmes de refroidissement liquide pour les racks de GPU. La densité thermique des puces Blackwell dépasse ce que l'air peut dissiper. Le passage au refroidissement liquide n'est pas un choix technologique — c'est une contrainte thermodynamique. Et quand une entreprise de chimie de l'eau paie 8,6 fois le chiffre d'affaires pour entrer dans ce marché, c'est que le refroidissement est devenu une couche d'infrastructure critique, au même titre que l'électricité.

La cascade n'est pas un accident. C'est la conséquence mécanique d'une industrie qui construit plus vite qu'elle ne peut s'approvisionner. Chaque couche est traitée comme un problème séparé. En réalité, elles forment un système : résoudre la pénurie de puces accélère la pénurie de mémoire, qui révèle la pénurie de stockage, qui exacerbe le besoin de refroidissement, qui alourdit la facture électrique.

2. Le matching fantôme

Microsoft annonce avoir atteint son objectif : "matcher" 100 % de sa consommation électrique avec de l'énergie renouvelable, via 40 gigawatts de contrats d'achat (PPA) répartis dans 26 pays. Le chiffre est impressionnant. La mécanique, moins.

Un PPA est un contrat financier. Microsoft achète de la capacité renouvelable quelque part dans le monde et "matche" cet achat avec sa consommation globale. Mais les électrons ne se téléportent pas. Le data center de Dublin fonctionne sur le réseau irlandais — un réseau dont les data centers consomment 22 % et dont le mix inclut du gaz naturel comme backup. Le matching est annuel et agrégé, pas horaire et local. C'est une comptabilité carbone, pas de la physique.

Le signal le plus révélateur est un glissement sémantique. La responsable développement durable de Microsoft déclare que l'électricité "carbon-free" — comprendre : nucléaire — "jouerait un rôle croissant" d'ici 2030. Le vocabulaire passe de "renewable" à "carbon-free." Ce n'est pas anodin. C'est un aveu : le renouvelable intermittent — éolien, solaire — ne peut pas fournir le baseload qu'un data center exige 24 heures sur 24. Pour le prouver, Microsoft a signé un accord avec Constellation Energy pour redémarrer Three Mile Island, le site du plus grave accident nucléaire de l'histoire américaine. Quand on choisit de relancer TMI malgré la charge symbolique, c'est que la contrainte physique a pris le dessus sur le narratif.

Le certificat vert n'est pas l'électron vert. Et la distance entre les deux croît avec chaque gigawatt contracté.

3. L'effet d'éviction français

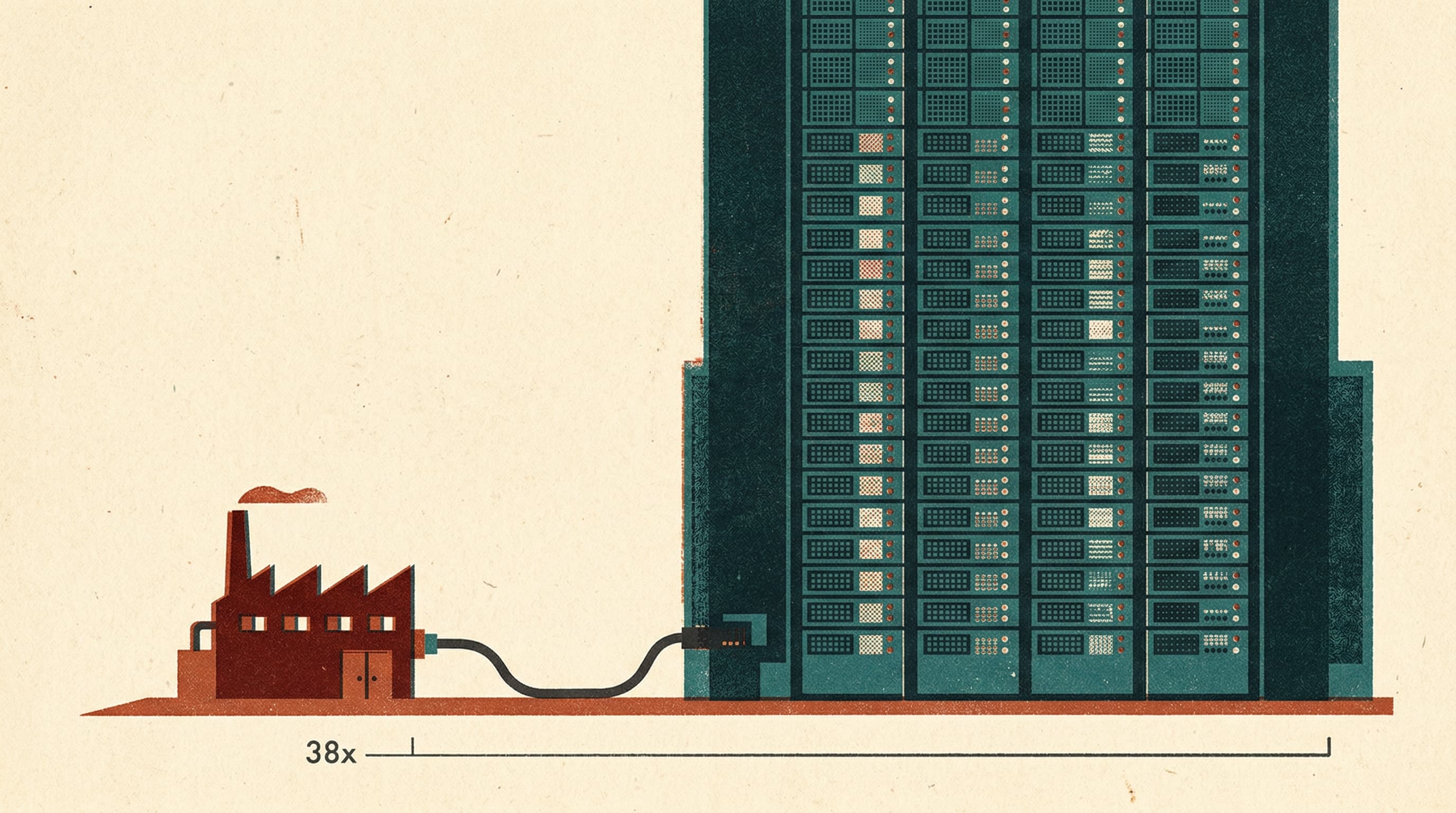

Pour un lecteur français, la cascade a une implication directe. En février 2026, Les Echos rapportaient que les data centers représentent désormais le premier poste d'investissement industriel en France : 67 milliards d'euros. Pour 2 800 emplois.

Faisons le calcul. Un emploi en data center "coûte" 23 millions d'euros d'investissement. Un emploi dans l'industrie manufacturière classique coûte 0,6 million d'euros. Le ratio d'inefficacité sociale est de 38 pour 1. Pour le prix d'un poste de technicien de data center, on pourrait créer 38 emplois en usine.

Les 125 milliards d'euros de "réindustrialisation" affichés par les statistiques officielles sont gonflés par ces investissements massifs en infrastructure numérique. Le problème n'est pas comptable — il est physique. Les délais de raccordement électrique haute tension sont de 5 à 7 ans. Chaque gigawatt verrouillé par un data center est un gigawatt physiquement indisponible pour une usine de batteries, une ligne de production automobile ou une fonderie de semiconducteurs. Ce n'est pas une addition à l'économie productive — c'est une soustraction.

L'image de la "Maladie Hollandaise" est tentante : un pays qui exporte sa ressource brute (l'électricité nucléaire bas-carbone) sous forme d'infrastructure pour l'IA étrangère, sans capturer la valeur ajoutée logicielle. Les puces restent américaines. Les modèles restent américains. La France fournit les watts.

Le contre-argument — et ses limites

Je dois nuancer. L'investissement en data centers n'est pas sans retombées. Les PPA de Microsoft, aussi comptables soient-ils, financent de la capacité renouvelable réelle : 19 GW déjà injectés dans des réseaux. L'accélération de la transition énergétique par la demande des hyperscalers est un effet systémique positif, même si les électrons physiques ne correspondent pas au marketing.

De même, la cascade des pénuries a un revers optimiste : chaque goulot crée un marché. Le refroidissement liquide, le stockage haute densité, la gestion thermique — ce sont des secteurs industriels où l'Europe a des compétences réelles. Schneider Electric (distribution électrique, 40 milliards d'euros de capitalisation) est déjà positionnée sur la plomberie de l'IA. Ecolab rachète CoolIT. Il y a de la valeur à capturer dans les couches physiques, même quand les couches logicielles sont américaines.

Et le contre-argument le plus solide : le stockage SSD est plus scalable que l'énergie. On construit des usines de NAND plus vite que des centrales. La cascade des pénuries n'est pas forcément permanente — elle pourrait se résoudre couche par couche, comme elle s'est révélée.

Mais ces nuances ne changent pas le diagnostic fondamental. La demande de compute IA croît de manière exponentielle. La capacité physique — réseau électrique, mémoire, stockage, refroidissement — croît de manière linéaire. L'écart se creuse. Et les décideurs qui pensent "abonnement SaaS" raisonnent sur le mauvais objet.

En conclusion

Dans mon article précédent, j'avais documenté le circuit financier circulaire qui alimente l'IA. Ce texte pose la question en amont : qu'est-ce que cet argent achète ?

La réponse est physique. Des watts. Des puces. De la mémoire. Du stockage. Du refroidissement liquide. Chaque couche révèle sa pénurie au moment où la précédente est partiellement levée. Le cloud n'est pas une abstraction — c'est du béton, du cuivre et de l'eau froide.

L'IA n'est pas un logiciel qu'on déploie. C'est une infrastructure qu'on alimente. Celui qui contrôle les watts contrôle l'inférence. Et pour l'instant, les watts sont en France — mais la valeur est en Californie.

La question, pour un décideur européen, n'est pas de savoir si l'IA va transformer son secteur. C'est de savoir s'il sera du côté de ceux qui capturent la valeur — ou de ceux qui fournissent l'électricité.

Sources :

Les Echos, "OpenAI a plus que triplé ses revenus sur un an", 20 janvier 2026

Stephen Nellis, "AI's demand for data could cause tight storage chip supplies, Solidigm executive says", Reuters, 20 mars 2026

Reuters, "Ecolab to buy CoolIT for $4.75 billion to tap into AI data center boom", 20 mars 2026

Padraic Halpin, "Microsoft to keep buying enough renewable energy to match all its electricity needs", Reuters (Dublin), 18 février 2026

Abu Sultan, "Microsoft says it is on pace to invest $50 billion in 'Global South' AI push", Reuters (Bengaluru), 18 février 2026

Mehdi Laghrari, "Le boom des data centers sauve l'investissement industriel en France", Les Echos, 6 février 2026