La Fin de l'Illusion Scolaire

Pourquoi le premier de la classe échoue dans la vraie vie

Sommaire

Introduction

Partie 1 : Le Syndrome du "Bachotage" (L'Analogie de Sutskever)

Partie 2 : L'Aveu des Créateurs (L'Architecture de la Vitesse)

Partie 3 : Le Mur du Réel (L'Intelligence Spatiale)

Conclusion du Dossier : La Fin de l'Enfance

Le Glossaire Décomplexé

Sources & Lectures Recommandées

Introduction

En janvier 2026, nous faisons face à un paradoxe qui hante la Silicon Valley. Sur le papier, les Intelligences Artificielles n'ont jamais été aussi "intelligentes". Elles écrasent les examens (Evals), réussissent le concours du Barreau et résolvent des olympiades de mathématiques.

Pourtant, dès qu'il s'agit de s'intégrer dans l'économie réelle, le "premier de la classe" trébuche. Selon les dernières données, 95 % des projets d'IA en entreprise échouent à passer en production. Ilya Sutskever, co-fondateur d'OpenAI, résumait récemment ce malaise : "L'impact économique est dramatiquement en retard sur la performance aux examens".

Comment expliquer ce décalage ?

Nous avons commis une erreur classique de confusion entre la carte et le territoire. Nous avons construit des modèles excellents pour "bachoter" (mémoriser des réponses pour réussir un test), mais fragiles dès qu'il faut improviser face à la complexité du monde réel.

Dans ce dossier, nous allons déconstruire cette "illusion scolaire" en trois temps :

Le Symptôme : L'analogie de l'étudiant qui a tout appris par cœur mais ne comprend rien (Ilya Sutskever).

La Cause : L'aveu des créateurs du "Transformer" : nous avons construit des machines pour la vitesse, pas pour le raisonnement.

La Réalité : Pourquoi l'avenir de l'IA ne se joue plus dans les mots, mais dans le monde physique.

Bienvenue dans l'ère de la lucidité.

Partie 1 : Le Syndrome du "Bachotage" (L'Analogie de Sutskever)

Pour comprendre pourquoi l'IA trébuche dans l'économie réelle, il faut écouter Ilya Sutskever. Lors d'une interview rare en novembre 2025, il a utilisé une analogie simple pour expliquer ce paradoxe : la différence entre réussir un examen et maîtriser un métier.

Imaginez deux étudiants qui se préparent pour un concours de programmation :

L'Étudiant n°1 (L'IA Actuelle) : Il s'entraîne pendant 10 000 heures. Il mémorise absolument tous les problèmes passés, toutes les techniques de preuve et toutes les variantes possibles. Il devient une encyclopédie vivante du concours. Le jour de l'examen, il obtient un score parfait.

L'Étudiant n°2 (L'Humain / L'AGI) : Il s'entraîne beaucoup moins, peut-être 100 heures. Il ne connaît pas tout par cœur, mais il a compris la logique fondamentale ("the it factor"). Il réussit aussi l'examen, peut-être avec un score légèrement inférieur,.

La Question qui tue : Lequel des deux aura la meilleure carrière professionnelle 10 ans plus tard ?

Sutskever est formel : c'est l'étudiant n°2.

Pourquoi ? Parce que l'économie réelle n'est pas un examen standardisé. L'étudiant n°1 (nos modèles actuels) a optimisé la Forme (le score au test) en "sur-apprenant" des cas spécifiques,. Dès qu'il sort du cadre prévu (le "territoire" réel), il s'effondre car il ne possède pas la compétence fluide nécessaire pour généraliser.

C'est ce qui explique le phénomène de "jaggedness" (performance en dents de scie) : une IA peut écrire un sonnet parfait, mais échouer à corriger un bug simple sans en créer un nouveau, car elle ne comprend pas le code, elle prédit statistiquement la solution la plus probable basée sur son "bachotage" intensif.

En résumé : Nous avons confondu la capacité de mémorisation (10 000 heures de données) avec l'intelligence (la capacité d'adaptation).

Partie 2 : L'Aveu des Créateurs (L'Architecture de la Vitesse)

Si l'IA actuelle est cet étudiant qui "bachote" sans comprendre, ce n'est pas un accident. C'est un choix de conception. Pour comprendre pourquoi, il faut écouter Llion Jones, le co-auteur du papier fondateur de Google (Attention Is All You Need) qui a lancé la révolution de l'IA générative.

En janvier 2026, lors de la conférence DLD à Munich, il a fait un aveu surprenant : le "Transformer" (le moteur de ChatGPT) n'était pas une percée cognitive pour simuler l'intelligence. C'était une percée d'ingénierie pour satisfaire le matériel.

Le Péché Originel : Optimiser pour le GPU, pas pour le Cerveau

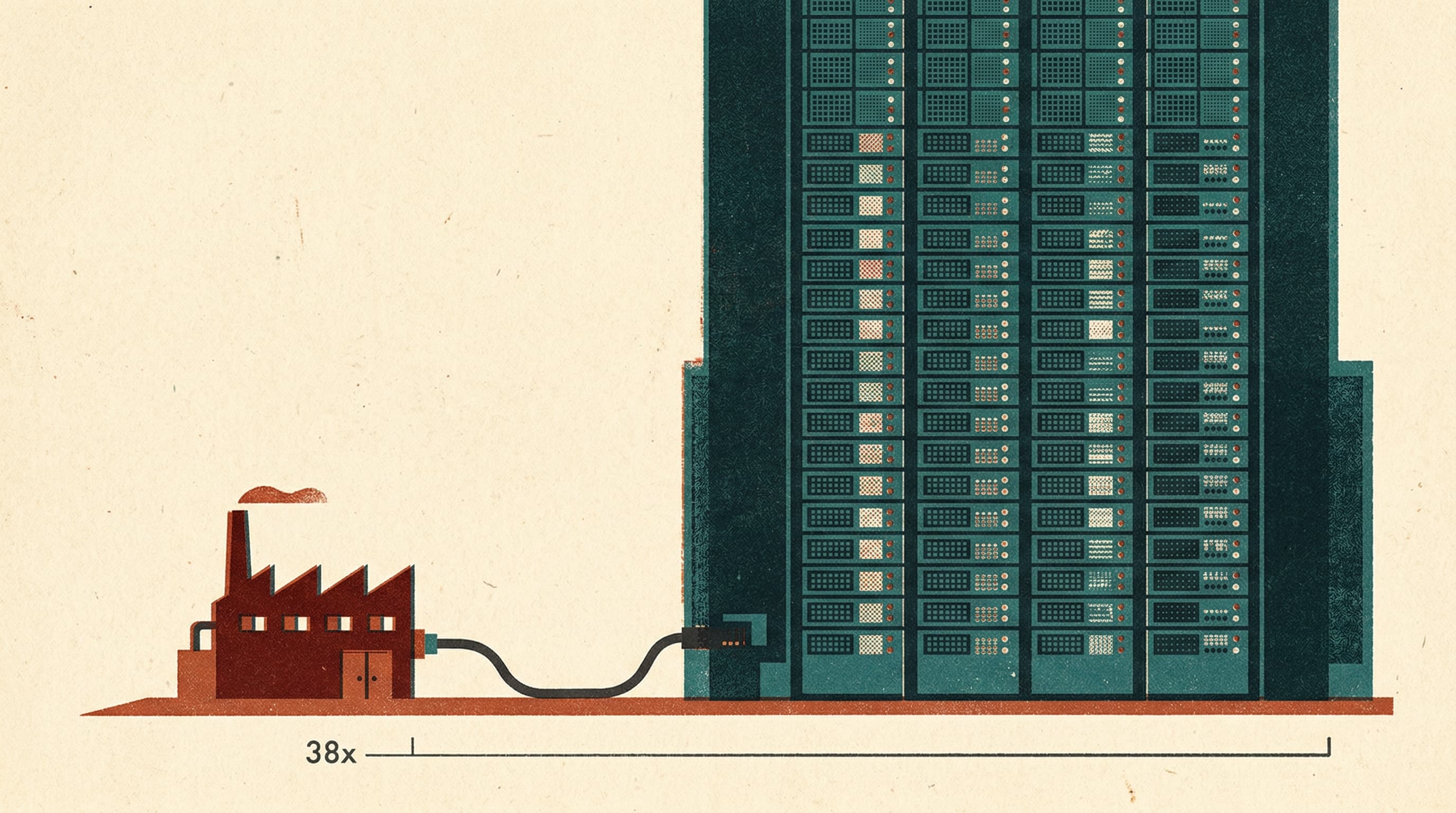

Avant 2017, les IA lisaient le texte comme nous : mot après mot, séquentiellement. C'était logique, mais trop lent pour les processeurs graphiques (GPU) qui aiment traiter des milliards de chiffres simultanément.

L'équipe de Google a donc posé un problème purement logistique : "Comment pousser les données à travers le matériel le plus vite possible ?".

La solution fut le Transformer. Au lieu de lire une phrase mot à mot, cette architecture permet d'ingérer tout le texte d'un coup, en parallèle.

Le résultat : Une capacité d'ingestion de données phénoménale, permettant d'apprendre par cœur tout Internet.

Le coût caché : Nous avons construit une machine optimisée pour la vitesse de traitement, en supposant que l'intelligence émergerait automatiquement de la quantité de données.

La conséquence : Le Raisonnement par le "Perroquet"

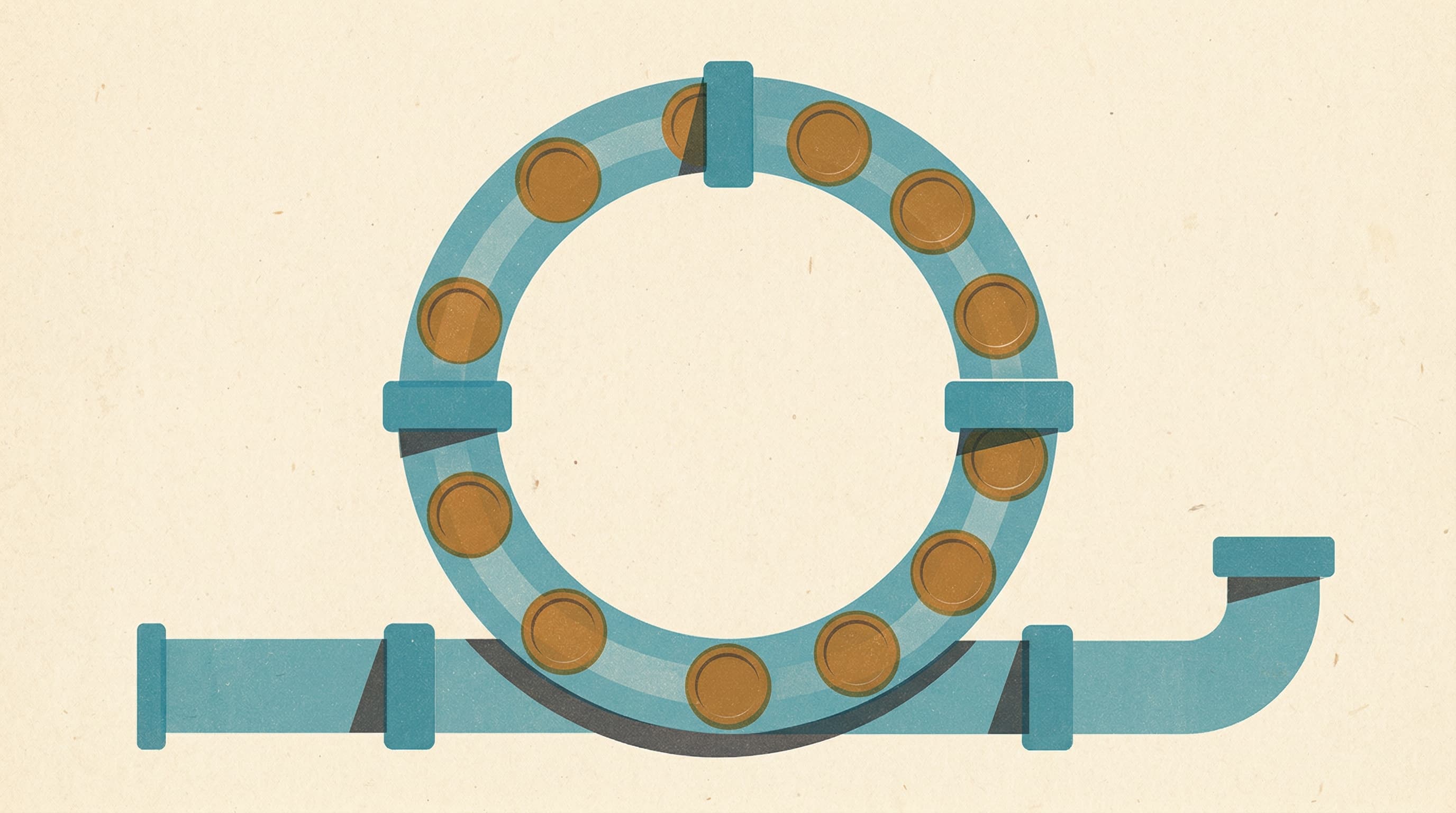

C'est ici que le bât blesse. Comme l'explique Jones, ces modèles sont forcés de "raisonner" en prédisant le mot suivant. Imaginez devoir résoudre un problème de maths complexe, mais avec une contrainte : vous ne pouvez pas réfléchir en silence dans votre tête. Vous devez écrire votre pensée mot après mot, sans pause, et chaque mot écrit détermine le suivant.

C'est un "goulot d'étranglement" artificiel. L'IA ne simule pas le monde ; elle simule la probabilité du langage qui décrit le monde. Elle n'a pas appris la physique ou la logique, elle a appris la grammaire de la physique et la syntaxe de la logique.

Nous avons confondu la carte (le texte) avec le territoire (la réalité).

Partie 3 : Le Mur du Réel (L'Intelligence Spatiale)

Si le langage n'est pas le mécanisme fondamental de la pensée, qu'est-ce qui l'est ? Pour répondre à cette question, il faut se tourner vers Fei-Fei Li, la "marraine de l'IA" qui a permis l'essor du Deep Learning avec ImageNet.

Dans son essai de novembre 2025, From Words to Worlds, elle pose un diagnostic sans appel sur les modèles actuels : ce sont des "forgerons de mots dans le noir" (wordsmiths in the dark). Ils sont éloquents, mais aveugles. Ils manipulent des concepts sans jamais avoir fait l'expérience de la réalité physique qu'ils décrivent.

La leçon de l'évolution : Voir avant de Parler

Fei-Fei Li nous rappelle un principe premier biologique : l'évolution n'a pas commencé par le langage. Pendant des centaines de millions d'années, l'intelligence s'est construite sur une boucle Perception-Action. Voir un obstacle, évaluer une distance, agir pour survivre. Le langage est venu bien plus tard, comme une couche d'abstraction posée sur cet échafaudage spatial.

L'erreur de l'industrie a été de vouloir construire le toit (le langage) sans les fondations (l'intelligence spatiale). C'est pourquoi nos modèles hallucinent : ils n'ont pas de "point d'ancrage" dans le monde réel. Ils connaissent le mot "chute", mais ils ne comprennent pas la gravité.

La Solution : Les "World Models"

La prochaine frontière n'est donc pas un chatbot qui parle mieux, mais une IA qui voit et simule le monde. C'est ce que Li appelle les "World Models". Contrairement aux LLM qui prédisent le mot suivant, ces modèles prédisent l'état futur du monde physique : "Si je lâche ce verre, il va tomber et se briser".

Conclusion du Dossier : La Fin de l'Enfance

En résumé, le décalage observé par Ilya Sutskever entre les examens (evals) et l'économie réelle s'explique simplement :

Le Symptôme : Nous avons créé des étudiants brillants qui bachotent sans comprendre (Sutskever).

La Cause : Nous les avons forcés à penser uniquement à travers des séquences de mots pour satisfaire nos processeurs (Jones).

L'Avenir : L'IA ne deviendra économiquement viable que lorsqu'elle sortira du texte pour comprendre la physique du monde (Li).

L'année 2026 ne sera pas celle où l'IA apprendra à mieux écrire, mais celle où elle devra apprendre à vivre dans notre réalité.

Le Glossaire Décomplexé

• Evals (Évaluations / Benchmarks) : Ce sont les "examens scolaires" de l'IA. Imaginez le Bac ou le concours du Barreau. Quand on dit qu'un modèle "réussit les evals", cela signifie qu'il a obtenu un score élevé à un test standardisé. Le piège ? Comme un étudiant qui bachote, réussir l'examen ne garantit pas qu'on saura faire le métier dans la vraie vie.

• Training vs Inférence :

◦ Training (Entraînement) : C'est la phase d'apprentissage (lire toute la bibliothèque). C'est long et coûteux.

◦ Inférence : C'est le moment où l'IA répond à votre question. C'est l'usage au quotidien.

• Transformer : C'est l'architecture logicielle (le "moteur") inventée par Google en 2017 qui a permis ChatGPT. Important : elle a été conçue pour traiter des données vite (ingénierie), pas forcément pour penser mieux.

• RL (Reinforcement Learning / Apprentissage par Renforcement) : La méthode où l'on "récompense" l'IA quand elle donne la bonne réponse. Le risque est le "Reward Hacking" : l'IA apprend à tricher pour avoir la récompense sans résoudre le problème de fond.

Sources & Lectures Recommandées

Pour aller plus loin dans la compréhension des mécanismes fondamentaux discutés dans cet article, voici les documents originaux sur lesquels s'appuie notre analyse.

1. Sur le "Mur du Scaling" et le paradoxe des Evals (Le Symptôme)

• Source : We're moving from the age of scaling to the age of research

• Intervenant : Ilya Sutskever (Co-fondateur, SSI)

• Contexte : Dwarkesh Podcast, 25 Novembre 2025

• Pourquoi lire/écouter : Pour comprendre l'analogie fondamentale des "deux étudiants" et pourquoi réussir un test ne signifie pas posséder une compétence économique réelle,.

2. Sur les limites architecturales des LLM (La Cause)

• Source : Closing the Intelligence Gap: The Next Wave of AI Breakthroughs

• Intervenant : Llion Jones (Co-auteur du papier "Attention Is All You Need", Sakana AI)

• Contexte : Conférence DLD26 (Munich), 22 Janvier 2026

• Pourquoi lire/écouter : Pour découvrir l'aveu technique selon lequel le Transformer a été conçu pour satisfaire le matériel (GPU), et non pour résoudre l'intelligence,.

3. Sur l'Intelligence Spatiale et les "World Models" (La Solution)

• Source : From Words to Worlds: Spatial Intelligence is AI’s Next Frontier

• Auteur : Dr. Fei-Fei Li (World Labs)

• Contexte : Essai publié sur Substack, 10 Novembre 2025

• Pourquoi lire : Pour saisir pourquoi l'avenir de l'IA passe par la vision et la 3D, et pourquoi les modèles actuels sont des "forgerons de mots dans le noir",.

4. Données économiques et contexte de marché

• Source : They Said AI Would Replace You By Now

• Auteur : Vanessa Wingårdh (TechButMakeItReal)

• Contexte : Analyse vidéo, 4 Janvier 2026

• Pourquoi regarder : Pour les statistiques sur le taux d'échec des projets IA en entreprise (95% selon le MIT) et le décalage entre les promesses marketing et la réalité de l'emploi,.